OpenAI sta introducendo (globalmente) una funzione chiamata age prediction in ChatGPT: un sistema che, usando alcuni segnali legati all’account, prova a capire se l’utente potrebbe essere minorenne (under 18). Se la previsione indica “probabilmente under 18”, ChatGPT attiva automaticamente un’esperienza con impostazioni di sicurezza più restrittive. In UE la distribuzione arriva “nelle prossime settimane”, per adeguarsi ai requisiti regionali.

Perché OpenAI lo fa: sicurezza “by default” per i “teen”

Il punto centrale è questo: OpenAI dichiara di voler garantire ai ragazzi un’esperienza più adatta all’età, applicando “extra safety settings” che riducono l’esposizione a contenuti o interazioni considerate più delicate. Non è (almeno nelle intenzioni dichiarate) un blocco dell’account, ma una modalità più prudente su certi argomenti.

Come funziona l’age prediction: segnali, non “lettura della carta d’identità”

OpenAI spiega che il sistema non si basa su un singolo dato, ma su diversi segnali associati al tuo account. Esempi citati nell’articolo:

- Argomenti generali di cui parli (non necessariamente il testo “parola per parola”, ma le macro-tematiche)

- Fasce orarie in cui usi ChatGPT

- Nelle FAQ viene citato anche che possono contare elementi come come e quando viene usato l’account e da quanto tempo esiste

OpenAI è esplicita su un punto importante: non è un sistema perfetto e può sbagliare. Se hai più di 18 anni e finisci per errore nella modalità teen, puoi rimediare tramite verifica dell’età.

Cosa cambia se ChatGPT “ti considera” under 18

Se il sistema prevede che l’account sia di un minorenne, vengono attivate impostazioni di sicurezza extra. OpenAI sottolinea che puoi comunque usare ChatGPT per imparare, creare, fare domande.

Le aree trattate con più cautela (per ridurre contenuti sensibili) includono:

- Violenza grafica / gore

- “Viral challenges” che potrebbero spingere a comportamenti rischiosi o dannosi

- Role play sessuale, romantico o violento

- Contenuti che promuovono standard estetici estremi, diete malsane o body shaming

Nota interessante: OpenAI afferma anche che non mostrerà ads nell’account in questa esperienza.

Se hai 18+ e vuoi “sbloccare” l’esperienza: la verifica età (e il caso Italia)

Se sei maggiorenne e vuoi rimuovere le impostazioni extra, puoi avviare la verifica età da qui: https://chatgpt.com/verify_age.

Italia: la regola dei 60 giorni

OpenAI specifica una particolarità: in Italia devi completare la verifica entro 60 giorni dal prompt, altrimenti alcune funzionalità potrebbero venire disabilitate.

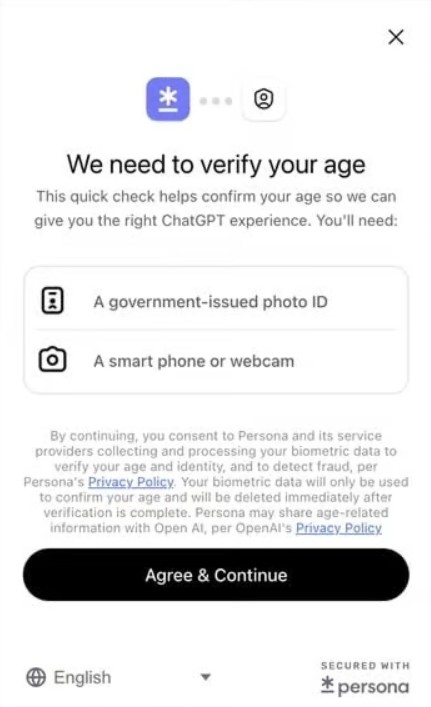

Chi verifica? Persona (terza parte) e cosa ti può chiedere

La verifica non viene fatta direttamente da OpenAI, ma da Persona, descritta come “trusted third-party company”.

A seconda del Paese, Persona può richiedere:

- Live selfie (foto in tempo reale con telefono o webcam)

- Documento governativo (es. patente, passaporto, documento equivalente)

Persona controlla data di nascita e corrispondenza tra selfie e foto sul documento (gli ID accettati variano per Paese).

Privacy: cosa vede OpenAI e cosa cancella Persona

Qui l’articolo entra nei dettagli che interessano molto a chi segue temi tech/privacy:

- Persona gestisce la verifica

- Persona elimina ID o selfie entro 7 giorni dalla verifica

- OpenAI non riceve né il documento né il selfie

- OpenAI riceve solo data di nascita o esito/previsione d’età e li conserva in modo sicuro, usandoli come descritto nella privacy policy

Inoltre: se non vuoi che OpenAI faccia age prediction sul tuo account, puoi verificare l’età con Persona; dopo la verifica, OpenAI dice che non eseguirà più age prediction su quell’account.

FAQ che chiariscono i dubbi più comuni

Due risposte meritano di essere riportate (in ottica “blog post”):

- “Devo verificare l’età per continuare a usare ChatGPT?”

No: puoi continuare anche con le impostazioni extra; la verifica serve se sei 18+ e vuoi rimuoverle. (In Italia: verifica entro 60 giorni o perdi alcune feature.) - “ChatGPT predice l’età anche se ho già inserito la data di nascita all’iscrizione?”

Sì: è presentato come un controllo aggiuntivo.

Implicazioni “da osservatore tech”: cosa significa davvero per gli utenti

Dal punto di vista prodotto, questa mossa è interessante perché combina due approcci:

- Stima probabilistica (age prediction) per applicare protezioni anche quando i dati dichiarati non bastano.

- Verifica forte (selfie/ID via terza parte) per chi vuole rimuovere le limitazioni, con un modello “privacy-preserving” (OpenAI non vede i documenti).

È anche un segnale di quanto le piattaforme AI stiano andando verso controlli “age-aware” come requisito pratico (soprattutto in Europa), senza trasformare tutto in un muro obbligatorio di KYC per chiunque.

Foto di Ron Lach : https://www.pexels.com/it-it/foto/smartphone-seduto-giovane-bambini-9785013/

Lascia un commento